Hasta 4.000 celebridades habrían sido ya víctimas de porno deepfake, según recoge The Guardian y denuncia Maldita.es

Un vídeo creado con IA de Lauren Sánchez, reportera y pareja de Jeff Bezos, quitándose la camiseta durante la investidura de Donald Trump, se volvió viral en Twitter (ahora X). El 96% de los deepfakes (vídeos manipulados con IA para suplantar la identidad), se usan para crear contenido porno de mujeres sin su consentimiento, en su mayoría famosas. Las herramientas con las que se generan son cada vez más accesibles y algunas utilizan estos contenidos para promocionarse en Instagram, Facebook y TikTok, lo que puede incumplir con sus políticas de anuncios.

Hasta 4.000 celebridades han sido víctimas de porno deepfake, según The Guardian. Un estudio reveló que 99% de las víctimas son mujeres. Liliana Arroyo, investigadora del Instituto de Innovación Social de ESADE, habló sobre el comienzo de su uso en la Twichería de Maldita Tecnología: “Los deepfakes nacen en 2017 (…). Cogieron la cara de una celebridad y la pusieron en una escena pornográfica”.

Hoy, las famosas siguen siendo un blanco habitual. En enero de 2024, imágenes sexualmente explícitas creadas con IA de la cantante Taylor Swift circularon en X. En marzo de 2024, Forbes detectó que en eBay se vendían miles de imágenes pornográficas “generadas con IA y retocadas con Photoshop de al menos 40 celebridades, entre ellas Margot Robbie, Selena Gómez y Jenna Ortega”.

También afecta a las mujeres en política. Un estudio identificó más de 35.000 deepfakes de 26 miembros del Congreso de EEUU, de los que 25 eran de mujeres.

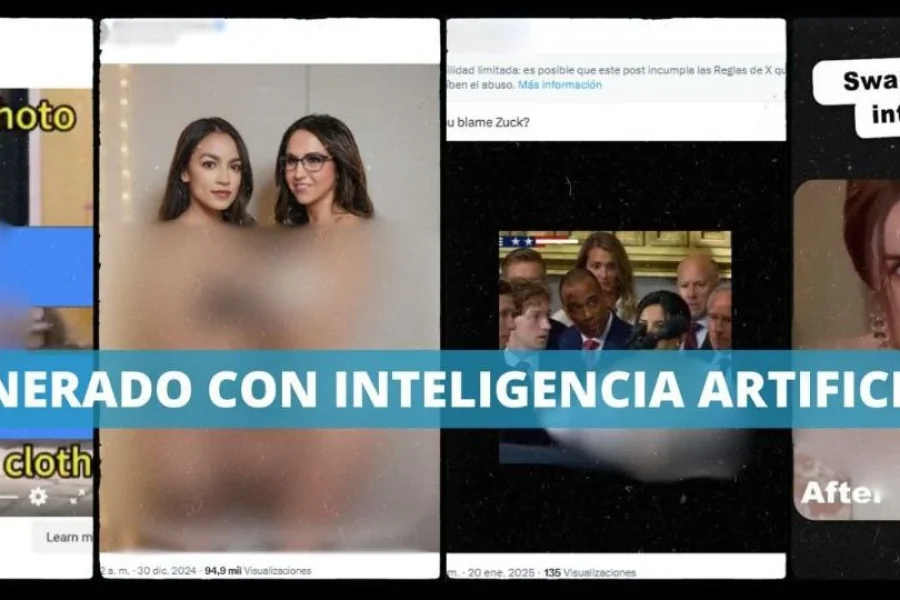

En X circulan imágenes y vídeos creados con IA de Alexandria Ocasio-Cortez, miembro demócrata de la Cámara de Representantes, que la representan en lencería junto a la republicana Lauren Boebert (el autor dice que ha sido creada con IA), con un disfraz navideño (la cuenta contesta con emojis de risa y un puño a alguien que afirma que es IA) y quitándose la camiseta (el creador es el mismo del vídeo de Lauren Sánchez). A pesar de que X prohíbe las imágenes de desnudez no consensuada, todas siguen disponibles.

Las tecnologías que se usan son variadas y cada vez más accesibles. 404 Media afirma que las imágenes de Swift podrían haber surgido de un grupo de Telegram. La app de mensajería también fue señalada por una investigación de WIRED que detectó en ella 50 bots que desnudan a personas o las editan realizando actos sexuales.

También hay apps y sitios webs que lo hacen. 24 millones de personas visitaron estas páginas sólo en septiembre de 2024, según un estudio que concluyó que la creación y difusión de estos contenidos “ha pasado de ser un servicio personalizado disponible en foros especializados de internet a un negocio en línea automatizado y ampliado, que aprovecha una gran cantidad de recursos para monetizar y comercializar sus servicios”.

“Cobran tan sólo 5 dólares por descargar miles de vídeos que muestran los rostros de celebridades, y aceptan pagos a través de Visa, Mastercard y criptomonedas”, afirma un análisis de NBC News. Una investigación de Forbes identificó tres de estas apps en la tienda de aplicaciones de Android que acumulan 11 millones de descargas y más de 100 vídeos en YouTube que las promocionan.

Algunas herramientas de generación de imagen con IA también se han utilizado para crear contenidos que sexualizan a famosas, a pesar de que la mayoría no permite generar imágenes explícitas. Con Grok, la IA de X, se crearon imágenes de Swift en ropa interior y de Kamala Harris en bikini.

En Instagram, Facebook y TikTok, Forbes detectó más de 2.500 anuncios que mostraban a actrices como Scarlett Johansson, Emma Watson y Gal Gadot besándose para promocionar estas apps. Webs de deepfakes sexuales usaron la imagen de Johansson y Watson para promocionarse en Facebook e Instagram. Alexios Martzarlis, autor de la newsletter Faked Up, descubrió 8.010 anuncios en Facebook e Instagram de una app para desnudar imágenes a comienzos de enero de 2025. Uno mostraba a Mikayla Demaiter, exjugadora de hockey, desnuda.

Las Normas comunitarias de Meta (Instagram y Facebook) prohíben los desnudos que enseñen pezones femeninos o genitales. Por su parte, TikTok exige que los anunciantes tengan el consentimiento de las personas representadas en sus anuncios, aunque sean creados con IA.

Esta tendencia preocupante puede tener consecuencias en la salud mental de las víctimas. En España, estos contenidos pueden vulnerar los derechos a la imagen y al honor y en muchos casos habilita para interponer acciones legales.

¿Te ha llegado un bulo? Verifica en el WhatsApp de Maldita.es en el +34 644229319.